بیشتر دانشمندان علوم کامپیوتر میگویند ایمنی هوش مصنوعی، هم اکنون، لازم و واجب است

بیش از ۳۵۰ مدیر ارشد و محقق در زمینه هوش مصنوعی بیانیهای را امضا کردهاند که در آن از سیاسیون میخواهند خطرات جدی ناشی از هوش مصنوعی کنترلنشده را ببینند و هشدار میدهند که ممکن است آینده بشریت در خطر باشد.

امضاکنندگان، از جمله "سام آلتمن" که مدیر عامل شرکت اوپناِیآی که شرکت پیشرو در هوش مصنوعیست در نامهای ۲۳ کلمهای که روز سهشنبه منتشر شده میگویند: "کاهش خطر انقراض ناشی از هوش مصنوعی باید در کنار سایر خطرات اجتماعی مانند همهگیریها و جنگ هستهای یک اولویت جهانی باشد. ایمنی هوش مصنوعی لازم و واجب است".

علمی؛ هشدار شدید گوگل، ماکروسافت، اوپناِیآی، دیپمایند، آنتروپیک و ۳۵۰ مدیر ارشد شرکتهای بزرگ: هوش مصنوعی میتواند خیلی زودتر از تغییرات آب و هوایی بشر را منقرض کند

"دن هندریکس" مدیر اجرایی "سایس" (CAIS) در مصاحبهای گفت: "رقابت در این صنعت به نوعی «مسابقه تسلیحاتی هوش مصنوعی» منجر شده که میتواند تشدید شود و مانند مسابقه تسلیحات هستهای، به طور بالقوه ما را به آستانه فاجعه برساند. پیشرفتهای اخیر در هوش مصنوعی ابزارهایی را ایجاد کرده که حامیان میگویند میتوانند در برنامههای کاربردی از تشخیص پزشکی گرفته تا نوشتن خلاصههای حقوقی مورد استفاده قرار گیرند، اما این نگرانی را نیز ایجاد کرده که این فناوری میتواند منجر به نقض حریم خصوصی، کمپینهای «اطلاعات غلط» قدرتمند شود و منجر به مشکلاتی در مورد «ماشینهای هوشمند» شود که خودشان فکر میکنند".

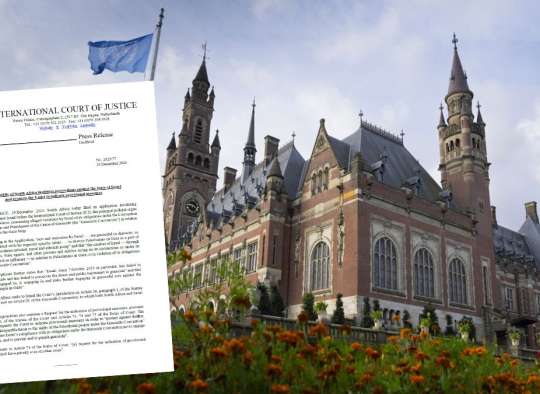

هندریکس میافزاید: "راههای زیادی وجود دارد که {هوش مصنوعی} ممکن است اشتباه کند". او معتقد است که باید بررسی شود که کدام ابزارهای هوش مصنوعی ممکن است برای مقاصد عمومی استفاده شوند و کدامها میتوانند با نیت مخرب مورد استفاده قرار گیرند. او همچنین نگرانی خود را از توسعه مستقل هوش مصنوعی مطرح کرد. هندریکس و امضاکنندگان این بیانیه خواستار همکاری بینالمللی برای برخورد با هوش مصنوعی به عنوان یک "اولویت جهانی" به منظور رسیدگی به خطرات آن هستند. این نامه همزمان با نشست شورای تجارت و فناوری ایالات متحده و اتحادیه اروپا در سوئد بود که در آن انتظار میرود سیاستمداران درباره تنظیم مقررات هوش مصنوعی صحبت کنند.

هوش مصنوعی هنوز هیچ قانون مشخصی ندارد و هرکسی میتواند از آن هر استفاده یا سوء استفادهای ببرد. حدود هشتاد سال پیش برخی از نویسندگان داستانهای علمی تخیلی (مانند ایزاک آسیموف)، در حالیکه نه ربات وجود داشت و نه هوش مصنوعی، پیشنهاداتی درباره وضع چندین قانون داده بودند تا این قوانین بتوانند بشر را از گزند ساختهاش حفظ کند. این قوانین هرگز بطور علمی بررسی و یا اجرا نشده و در حد داستان باقیماندهاند. با اینکه چندین کارگروه "اتیک هوش مصنوعی" در دنیا تشکیل شده اما آنها بر سر کوچکترین اظهار نظرهای یکدیگر و توافق و تفاهم بر سر چند قانون اصلی پایه نیز با هم اختلاف اساسی و درگیری دارند.

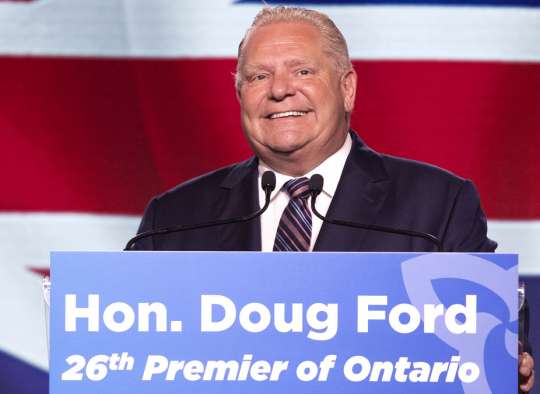

"راهول کریشنان" استادیار دپارتمان علوم کامپیوتر دانشگاه تورنتو میگوید که قوانین هوش مصنوعی "هنوز در مرحله بررسی و تدوین" هستند اما مهمترین موضوع در این باره باید وجود یک "تعادل خوب" بین پیشرفت و تشخیص خوبی و بدی وجود داشته باشد تا اطمینان حاصل شود که فناوریها به طور ایمن توسعه یافته و بدون مانع از پیشرفتها استفاده میشوند. او میگوید که امکان و احتمال "سوء استفاده" از هوش مصنوعی را به خوبی میبیند و درک میکند و میداند که میشود بر نحوه برنامهریزی الگوریتمهای یادگیری هوش مصنوعی اثر گذاشت و نتایج فاجعهباری گرفت، از جمله پخش اخبار غلط یا معکوس نشان دادن یک موضوع صحیح.

شرکتهای بزرگ و دو پدرخوانده هوش مصنوعی هم نگران هستند

علاوه بر آلتمن از اوپناِیآی ، امضاکنندگان دیگر این بیانیه شامل مدیران عامل شرکتهای هوش مصنوعی "دیپمایند" و "آنتروپیک"، مدیران مایکروسافت و گوگل هم میشود. در میان امضاء کنندگان نام "جفری هینتون" دانشمند کامپیوتر بریتانیایی - کانادایی و "یوشوا بنجیو" استاد علوم کامپیوتر دانشگاه مونترال که دو نفر از سه نفر به اصطلاح "پدرخواندههای هوش مصنوعی" که جایزه "تورینگ" ۲۰۱۸ را برای کار خود در زمینه یادگیری عمیق دریافت کردهاند، به چشم میخورد.

هینتون پیشتر به رویترز گفته بود که هوش مصنوعی میتواند تهدیدی "فوریتر" برای بشریت نسبت به تغییرات آب و هوایی باشد. او اخیرا از سمت خود در گوگل استعفا داد تا آزادانهتر در مورد نگرانیهای خود در مورد توسعه سریع هوش مصنوعی صحبت کند. بنجیو نیز قبلا همراه با "ایلان ماسک" به همراه بیش از ۱,۰۰۰ کارشناس و مدیر صنعتی دیگر در ماه آوریل امسال به خطرات احتمالی هوش مصنوعی برای جامعه اشاره کرده بودند.

علاوه بر اینها استادان دانشگاهها، از "هاروارد" گرفته تا دانشگاه "تسینگهوای" چین نیز این بیانیه را امضا کردهاند؛ اما "یان لوکان" فرانسوی که سومین پدرخوانده هوش مصنوعیست همراه با "اندرو نگ" یکی از بنیانگذاران "دیپلرنینگ" با هر گونه توقف برای این علم مخالفند. یان اکنون برای شرکت "متا" (فیسبوک) کار میکند که در این امضاء شرکت ندارد.

امضاکنندگان، از جمله "سام آلتمن" که مدیر عامل شرکت اوپناِیآی که شرکت پیشرو در هوش مصنوعیست در نامهای ۲۳ کلمهای که روز سهشنبه منتشر شده میگویند: "کاهش خطر انقراض ناشی از هوش مصنوعی باید در کنار سایر خطرات اجتماعی مانند همهگیریها و جنگ هستهای یک اولویت جهانی باشد. ایمنی هوش مصنوعی لازم و واجب است".

علمی؛ هشدار شدید گوگل، ماکروسافت، اوپناِیآی، دیپمایند، آنتروپیک و ۳۵۰ مدیر ارشد شرکتهای بزرگ: هوش مصنوعی میتواند خیلی زودتر از تغییرات آب و هوایی بشر را منقرض کند

"دن هندریکس" مدیر اجرایی "سایس" (CAIS) در مصاحبهای گفت: "رقابت در این صنعت به نوعی «مسابقه تسلیحاتی هوش مصنوعی» منجر شده که میتواند تشدید شود و مانند مسابقه تسلیحات هستهای، به طور بالقوه ما را به آستانه فاجعه برساند. پیشرفتهای اخیر در هوش مصنوعی ابزارهایی را ایجاد کرده که حامیان میگویند میتوانند در برنامههای کاربردی از تشخیص پزشکی گرفته تا نوشتن خلاصههای حقوقی مورد استفاده قرار گیرند، اما این نگرانی را نیز ایجاد کرده که این فناوری میتواند منجر به نقض حریم خصوصی، کمپینهای «اطلاعات غلط» قدرتمند شود و منجر به مشکلاتی در مورد «ماشینهای هوشمند» شود که خودشان فکر میکنند".

هندریکس میافزاید: "راههای زیادی وجود دارد که {هوش مصنوعی} ممکن است اشتباه کند". او معتقد است که باید بررسی شود که کدام ابزارهای هوش مصنوعی ممکن است برای مقاصد عمومی استفاده شوند و کدامها میتوانند با نیت مخرب مورد استفاده قرار گیرند. او همچنین نگرانی خود را از توسعه مستقل هوش مصنوعی مطرح کرد. هندریکس و امضاکنندگان این بیانیه خواستار همکاری بینالمللی برای برخورد با هوش مصنوعی به عنوان یک "اولویت جهانی" به منظور رسیدگی به خطرات آن هستند. این نامه همزمان با نشست شورای تجارت و فناوری ایالات متحده و اتحادیه اروپا در سوئد بود که در آن انتظار میرود سیاستمداران درباره تنظیم مقررات هوش مصنوعی صحبت کنند.

هوش مصنوعی هنوز هیچ قانون مشخصی ندارد و هرکسی میتواند از آن هر استفاده یا سوء استفادهای ببرد. حدود هشتاد سال پیش برخی از نویسندگان داستانهای علمی تخیلی (مانند ایزاک آسیموف)، در حالیکه نه ربات وجود داشت و نه هوش مصنوعی، پیشنهاداتی درباره وضع چندین قانون داده بودند تا این قوانین بتوانند بشر را از گزند ساختهاش حفظ کند. این قوانین هرگز بطور علمی بررسی و یا اجرا نشده و در حد داستان باقیماندهاند. با اینکه چندین کارگروه "اتیک هوش مصنوعی" در دنیا تشکیل شده اما آنها بر سر کوچکترین اظهار نظرهای یکدیگر و توافق و تفاهم بر سر چند قانون اصلی پایه نیز با هم اختلاف اساسی و درگیری دارند.

"راهول کریشنان" استادیار دپارتمان علوم کامپیوتر دانشگاه تورنتو میگوید که قوانین هوش مصنوعی "هنوز در مرحله بررسی و تدوین" هستند اما مهمترین موضوع در این باره باید وجود یک "تعادل خوب" بین پیشرفت و تشخیص خوبی و بدی وجود داشته باشد تا اطمینان حاصل شود که فناوریها به طور ایمن توسعه یافته و بدون مانع از پیشرفتها استفاده میشوند. او میگوید که امکان و احتمال "سوء استفاده" از هوش مصنوعی را به خوبی میبیند و درک میکند و میداند که میشود بر نحوه برنامهریزی الگوریتمهای یادگیری هوش مصنوعی اثر گذاشت و نتایج فاجعهباری گرفت، از جمله پخش اخبار غلط یا معکوس نشان دادن یک موضوع صحیح.

شرکتهای بزرگ و دو پدرخوانده هوش مصنوعی هم نگران هستند

علاوه بر آلتمن از اوپناِیآی ، امضاکنندگان دیگر این بیانیه شامل مدیران عامل شرکتهای هوش مصنوعی "دیپمایند" و "آنتروپیک"، مدیران مایکروسافت و گوگل هم میشود. در میان امضاء کنندگان نام "جفری هینتون" دانشمند کامپیوتر بریتانیایی - کانادایی و "یوشوا بنجیو" استاد علوم کامپیوتر دانشگاه مونترال که دو نفر از سه نفر به اصطلاح "پدرخواندههای هوش مصنوعی" که جایزه "تورینگ" ۲۰۱۸ را برای کار خود در زمینه یادگیری عمیق دریافت کردهاند، به چشم میخورد.

هینتون پیشتر به رویترز گفته بود که هوش مصنوعی میتواند تهدیدی "فوریتر" برای بشریت نسبت به تغییرات آب و هوایی باشد. او اخیرا از سمت خود در گوگل استعفا داد تا آزادانهتر در مورد نگرانیهای خود در مورد توسعه سریع هوش مصنوعی صحبت کند. بنجیو نیز قبلا همراه با "ایلان ماسک" به همراه بیش از ۱,۰۰۰ کارشناس و مدیر صنعتی دیگر در ماه آوریل امسال به خطرات احتمالی هوش مصنوعی برای جامعه اشاره کرده بودند.

علاوه بر اینها استادان دانشگاهها، از "هاروارد" گرفته تا دانشگاه "تسینگهوای" چین نیز این بیانیه را امضا کردهاند؛ اما "یان لوکان" فرانسوی که سومین پدرخوانده هوش مصنوعیست همراه با "اندرو نگ" یکی از بنیانگذاران "دیپلرنینگ" با هر گونه توقف برای این علم مخالفند. یان اکنون برای شرکت "متا" (فیسبوک) کار میکند که در این امضاء شرکت ندارد.

بیشتر بخوانید:

- علمی؛ دانشمندان کانادایی و آمریکایی با هوش مصنوعی اولین آنتیبیوتیک برای نابودی یک باکتری بسیار کُشنده و مقاوم بیمارستانی را ساختند

- علمی؛ محققان دانشگاهی کانادا: کودکان یادگیری از رباتهای هوشمند را به انسانهایی که کمتر میدانند، ترجیح میدهند

- علمی؛ روش تشخیص جدید بیماری آلزایمر با دقتی بیشتر از ۹۰%: هوش مصنوعی

- مشاغلی که هوش مصنوعی آنلاین جدید "چت جیپیتی" میتواند آنها را نابود کند چیستند؟

- علمی؛ آغاز جنگ آنلاین هوش مصنوعیها: پس از ظهور چتجیپیتی هوش مصنوعی مکالمهای میکروسافت، گوگل اعلان کرد مشابه آن را به نام بارد عرضه میکند

- هوش مصنوعی در ژن انسان یک جد ناشناخته "روح" دختر نوجوان پیدا کرد

- برنامه هوش مصنوعی که سکته را پیشبینی و پیشگیری میکند بالاترین جایزه اجتماعی بیزینسی کانادا را بدست آورد

- دکتر امین مدنی؛ پزشک تورنتویی نخبهای که انقلاب هوش مصنوعی را وارد عمل جراحی کرد

- علمی: دانشمندان با هوش مصنوعی و دستکاری ژن، به یک قدمی زنده کردن انسانهای گذشته و آینده رسیدند

- هوش مصنوعی 50% کارهای انسانی را طی 15 سال حذف میکند

- محققان امآیتی هوش مصنوعی مبتلا به روانپریشی درست کردند

اگر شما همکاری گرامی ما هستی، مرسی که این مطلب را خواندی، اما کپی نکن و با تغییر به نام خودت نزن، خودت زحمت بکش!

پروتکل علمی - پزشکی جهانی برای مقابله کلیه ویروسهایی مانند کرونا که انتقالشان از طریق بسته هوایی است:

۱- ماسک ان-۹۵ بزنید، کرونا از ماسکهای معمولی رد میشود. ۲- فیلتر هوای قوی هپا بگذارید. ۳- تا جایی که میتوانید از مردم حذر کنید. ۴- تغذیه خوب و سالم داشته باشید، مقادیر زیاد ویتامین C و D مصرف کنید. ۵- بسیار ورزش کنید. ۶- اگر توانستید حتما واکسن بزنید.

۱- ماسک ان-۹۵ بزنید، کرونا از ماسکهای معمولی رد میشود. ۲- فیلتر هوای قوی هپا بگذارید. ۳- تا جایی که میتوانید از مردم حذر کنید. ۴- تغذیه خوب و سالم داشته باشید، مقادیر زیاد ویتامین C و D مصرف کنید. ۵- بسیار ورزش کنید. ۶- اگر توانستید حتما واکسن بزنید.

Date: Tuesday, May 30, 2023 - 21:15

درباره نویسنده/هنرمند

| Arash Moghaddam آرش مقدم مدرک کارشناسی کامپیوتر و تخصص تولید رسانه دیجیتال دارد و مدیریت تولید بیش ۹ رسانه تصویری، چاپی و اینترنتی را بعهده داشته است. |

ویراستار اول: آرش مقدم؛ ویراستار نهایی: پر ابراهیمی - ویراستاری موقت: عباس حسنلو

ویراستار اول: آرش مقدم؛ ویراستار نهایی: پر ابراهیمی - ویراستاری موقت: عباس حسنلو